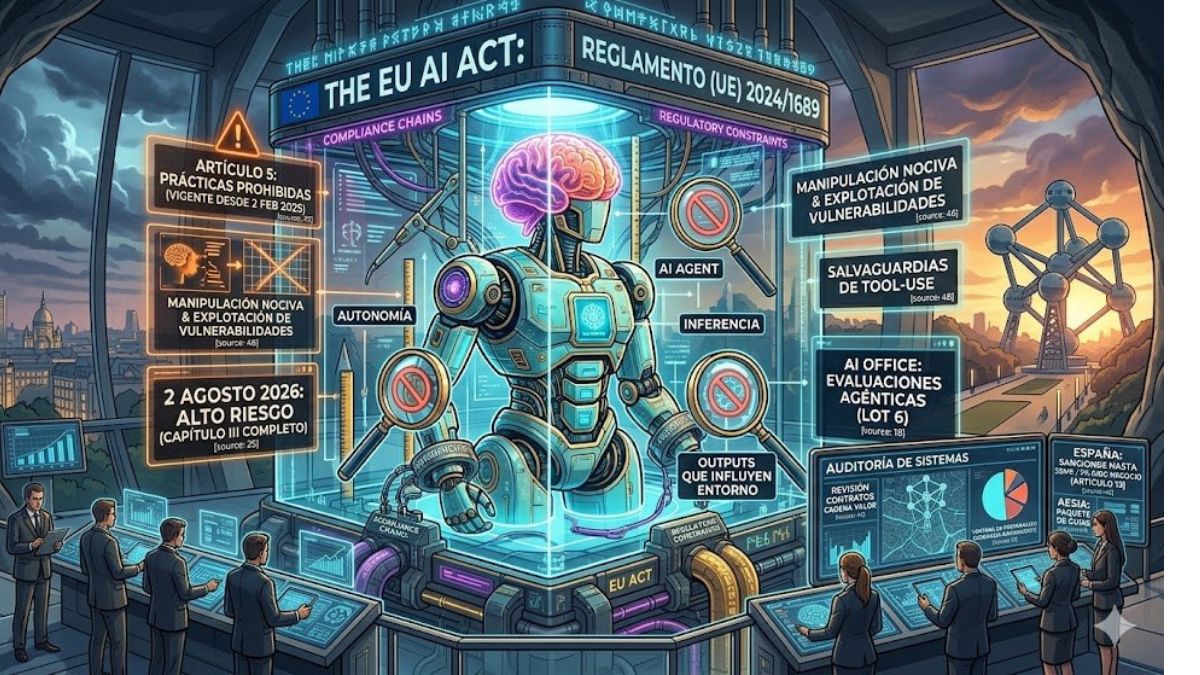

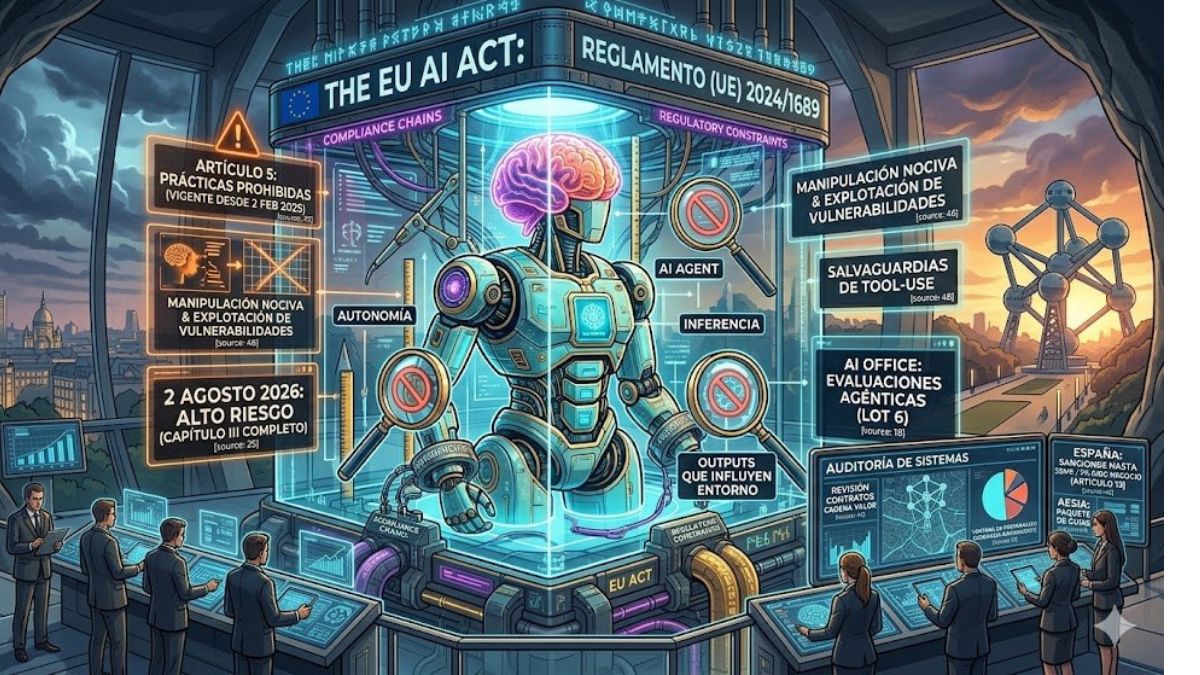

El EU AI Act Q2 2026: la Comisión Europea aclara, discretamente, el encaje legal de los agentes de IA

Las FAQ del 'AI Act Service Desk' incluyen dos respuestas que confirman la aplicación del Reglamento (UE) 2024/1689 a los agentes de IA, generativos o no, sin crear una categoría jurídica separada. La clarificación llega a menos de cuatro meses de la fecha crítica del calendario regulatorio europeo

(Imagen: Pablo Sáez)

El EU AI Act Q2 2026: la Comisión Europea aclara, discretamente, el encaje legal de los agentes de IA

Las FAQ del 'AI Act Service Desk' incluyen dos respuestas que confirman la aplicación del Reglamento (UE) 2024/1689 a los agentes de IA, generativos o no, sin crear una categoría jurídica separada. La clarificación llega a menos de cuatro meses de la fecha crítica del calendario regulatorio europeo

(Imagen: Pablo Sáez)

La pregunta llevaba meses sobrevolando cada foro y grupo de trabajo sobre regulación tecnológica en Europa: ¿están los agentes de inteligencia artificial cubiertos por el AI Act? A fecha de 13 de abril de 2026, la respuesta consta en fuente oficial. El AI Act Service Desk, la plataforma gestionada por DG CONNECT para apoyar la aplicación del Reglamento, incluye dos respuestas sobre cómo encajan los agentes de IA en el marco del Reglamento (UE) 2024/1689. Lo hace a menos de cuatro meses del 2 de agosto de 2026, fecha de aplicación general de las obligaciones más exigentes, y en plena explosión de herramientas agénticas, como CrewAI, Devin, OpenAI Agents SDK o Microsoft Copilot Agents, que están transformando cómo las empresas integran la IA. El propio EDPS identificó la IA agéntica como una de las seis tendencias en su informe TechSonar 2025-2026, y la Comisión publicó en enero de 2026 un informe específico sobre el potencial y los riesgos de estos sistemas.

...