La trascendencia del dato en los sistemas de inteligencia artificial jurídica

El verdadero valor y principal riesgo de estos sistemas no reside en los algoritmos, sino en los datos que los sustentan

(Imagen: E&J)

La trascendencia del dato en los sistemas de inteligencia artificial jurídica

El verdadero valor y principal riesgo de estos sistemas no reside en los algoritmos, sino en los datos que los sustentan

(Imagen: E&J)

La incorporación progresiva de sistemas de inteligencia artificial (IA) al sector jurídico constituye uno de los fenómenos más relevantes de la actual transformación digital del Derecho. Herramientas de IA especializada que dominan la práctica legal («IA jurídica») se emplean de forma habitual para el análisis contractual, la búsqueda jurisprudencial avanzada, el análisis predictivo o la redacción de documentos jurídicos, entre otros. La tecnología legal o legaltech basada en IA ha dejado de ser una promesa futura para convertirse en una realidad operativa en despachos de abogados, departamentos jurídicos y administraciones públicas.

Este proceso de adopción tecnológica presenta oportunidades evidentes en términos de eficiencia, reducción de costes y acceso a la información jurídica. No obstante, también plantea desafíos jurídicos, éticos y regulatorios de primer orden, en especial, cuando dichas herramientas inciden directamente en la toma de decisiones que pueden afectar a derechos, obligaciones y expectativas legítimas de las personas.

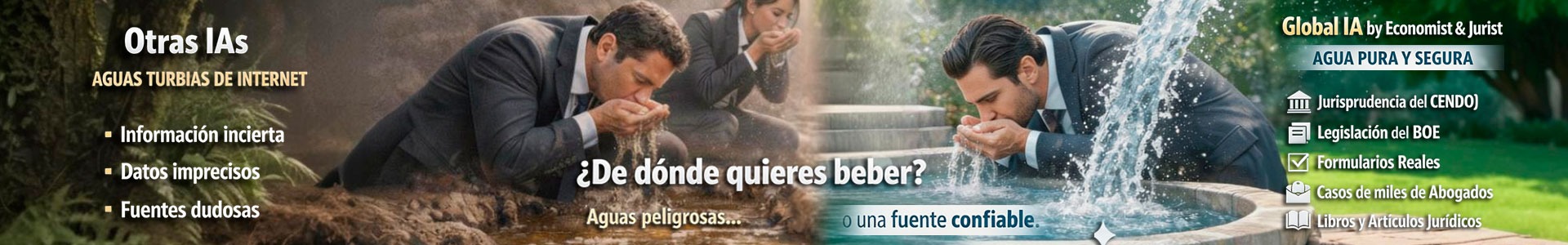

En este escenario, el debate no puede centrarse exclusivamente en la sofisticación de los algoritmos o en la arquitectura y potencia de los modelos de lenguaje. El verdadero valor de los sistemas de IA jurídica reside en los datos que los alimentan. La IA jurídica no crea conocimiento jurídico ex novo, sino que procesa, correlaciona e interpreta datos jurídicos preexistentes. De ahí que la calidad, veracidad y gobernanza de dichos datos condicionen directamente la fiabilidad del sistema y, en última instancia, la confianza que el operador jurídico pueda depositar en él.

Por ello, resulta ineludible analizar la trascendencia del dato en los sistemas de IA jurídica, y las prácticas orientadas a garantizar la seguridad y confiabilidad de estas soluciones.

Suscríbete a nuestra

NEWSLETTER

(Imagen: E&J)

El dato como elemento nuclear de la IA jurídica

A diferencia de otros sectores, el jurídico se caracteriza por un elevado grado de formalización normativa, interpretación contextual y consecuencias jurídicas. La IA jurídica opera sobre datos que no son meramente informativos, sino esencialmente normativos, interpretativos y valorativos, como la legislación, jurisprudencia, doctrina, contratos o escritos procesales.

En este sentido, un sistema de IA jurídica será tan fiable como lo sean los datos que lo alimentan. Si los datos son incompletos, sesgados, desactualizados o erróneos, el resultado generado será inevitablemente defectuoso, por muy avanzado que sea el modelo utilizado. De esta manera, la exactitud, integridad, actualidad, relevancia y representatividad de los datos jurídicos y, en definitiva, la calidad de los datos, es la base de la fiabilidad y seguridad de estos sistemas. A ello se añade la necesidad de una adecuada contextualización temporal, territorial y normativa.

Además, en el ámbito jurídico la veracidad del dato adquiere una dimensión cualitativa. No se trata únicamente de una exactitud formal, sino también de coherencia con el ordenamiento jurídico vigente y de adecuación a la finalidad jurídica perseguida. Un sistema que ofrece respuestas aparentemente sólidas, pero basadas en datos jurídicamente obsoletos o mal contextualizados (legislación, jurisprudencia…), puede generar una falsa sensación de seguridad, con consecuencias jurídicas, económicas y reputacionales de gran calado.

La veracidad en la IA jurídica

Uno de los principales retos de los sistemas de IA jurídica es garantizar la veracidad de los resultados producidos. En el ámbito del Derecho, el operador jurídico no puede aceptar respuestas plausibles pero incorrectas, puesto que la práctica jurídica exige rigor, precisión y fundamentación.

Los modelos de lenguaje pueden generar información incorrecta, distorsionada o, incluso, inventada, presentándola como si fuese verdadera y aparentemente coherente y convincente. Este fenómeno, conocido como «alucinaciones», representa un riesgo particularmente grave en el contexto legal. Una cita jurisprudencial inexistente, una referencia normativa incorrecta o una interpretación doctrinal errónea no constituyen un mero error técnico, sino un riesgo relevante que puede conducir a errores procesales, asesoramiento legal perjudicial, responsabilidades profesionales e incluso sanciones y, en definitiva, a una desconfianza por parte de la sociedad en general.

De hecho, la reciente experiencia española ofrece ejemplos ilustrativos: la investigación abierta por el Tribunal Superior de Justicia de Canarias a un abogado por citar jurisprudencia e informes oficiales inexistentes, presuntamente generados por IA; o referencias jurisprudenciales inexistentes por parte de un juez de Ceuta en una de sus resoluciones (citadas primeramente por la Fiscalía en su informe). El riesgo no es meramente teórico, sino real y presente.

Desde una perspectiva deontológica, el abogado continúa siendo plenamente responsable del asesoramiento que presta, con independencia de las herramientas de IA que utilice. Esto es, el uso de IA no exonera del deber de diligencia, verificación y contraste de las fuentes por parte de los profesionales del Derecho. Ahora bien, conviene matizar que, en el ámbito jurídico, la veracidad no siempre implica una única respuesta correcta, sino que su validez en ocasiones reside en su interpretación y argumentación (el famoso “depende”), que es precisamente el terreno del juicio profesional. Así, una “alucinación jurídica” sería una respuesta incorrecta (contiene información falsa) o mal fundamentada (cita una fuente que no respalda la afirmación).

(Imagen: E&J)

¿Cómo garantizar la seguridad y confiabilidad de la IA jurídica?

- Gobernanza del dato

La gobernanza del dato constituye el pilar fundamental para garantizar la confiabilidad de los sistemas de IA jurídica. Una adecuada gobernanza implica definir de forma clara qué datos se utilizan, cuál es su origen, con qué finalidad se tratan y bajo qué base jurídica. Asimismo, exige establecer políticas de actualización, conservación y supresión de datos, así como asignar responsabilidades internas claramente definidas, y articularse en torno a procedimientos documentados que abarquen todo el ciclo de vida del dato. Una gobernanza sólida permite reducir los riesgos legales, mejorar la calidad del sistema y reforzar la confianza de los usuarios y clientes.

- Auditabilidad

La seguridad y fiabilidad de la IA jurídica requieren de mecanismos de auditoría. Estos permiten evaluar la precisión del sistema, su propensión a generar alucinaciones, su robustez frente a entradas ambiguas, y su comportamiento en distintos contextos jurídicos. Aunque, cabe mencionar que la auditabilidad, además de una cuestión técnica, depende en gran medida de una adecuada gobernanza de datos. Al fin y al cabo, un sistema auditable y verificable resulta esencial especialmente cuando se emplea en tareas críticas o de alto impacto jurídico.

- Transparencia y explicabilidad

La transparencia constituye otro elemento esencial para la seguridad y confianza en la IA jurídica. Los usuarios deben comprender el funcionamiento del sistema, qué datos se utilizan, cuáles son sus limitaciones y qué riesgos pueden derivarse de su uso. La explicabilidad, por su parte, y en la medida en que la tecnología lo permita, contribuye a que el profesional pueda evaluar críticamente los resultados ofrecidos y detectar posibles errores o sesgos.

- Generación Aumentada por Recuperación (RAG)

Desde el punto de vista técnico, cabe mencionar que una de las estrategias más eficaces para reducir alucinaciones es la denominada Retrieval Augmented Generation o Generación Aumentada por Recuperación (RAG). Esta tecnología conecta el modelo de lenguaje con bases de datos jurídicas controladas, obligándole a fundamentar sus respuestas en la información y documentos previamente recuperados. El uso de RAG permite incorporar citas internas, referencias verificables y mayor trazabilidad de las fuentes, reduciendo significativamente el riesgo de invención de contenidos. Sin embargo, no elimina por completo las alucinaciones, al persistir errores como el misgrounding (citar una fuente real pero tergiversando su contenido).

- Supervisión humana y responsabilidad profesional

Ninguna tecnología ni medida técnica puede reemplazar la profundidad del juicio profesional, la responsabilidad y la comprensión del profesional del Derecho, por lo que la supervisión humana crítica, informada y experta resulta fundamental para la integración segura de sistemas de IA jurídica. La IA debe concebirse como un instrumento de apoyo, nunca como un sustituto del criterio jurídico profesional. Por consiguiente, la responsabilidad última recae siempre en el profesional, que debe validar, contextualizar y, en su caso, corregir los resultados ofrecidos por la IA.

(Imagen: E&J)

Conclusiones

La inteligencia artificial jurídica se perfila como una herramienta de enorme potencial transformador para la práctica del Derecho. Sin embargo, su legitimidad, utilidad y aceptación social dependen directamente de la veracidad y calidad de los datos que la alimentan. En un ámbito como es el jurídico, el dato deja de ser un mero insumo técnico para convertirse en un elemento jurídico de primer orden, cuya gestión responsable resulta imprescindible para garantizar la seguridad jurídica y la confianza en el sistema.

Los principales riesgos de la IA jurídica no derivan tanto de la complejidad de los algoritmos, sino de la utilización de datos incompletos, sesgados, desactualizados o mal contextualizados. De esta manera, la generación de resultados aparentemente coherentes, pero jurídicamente incorrectos o infundados, suponen un desafío crítico para la seguridad jurídica, la confianza de los operadores jurídicos y la responsabilidad profesional. Por ello, la veracidad del dato, entendida no solo como exactitud formal, sino como coherencia normativa y adecuación al contexto jurídico aplicable, constituye un requisito imprescindible para cualquier sistema de IA jurídica confiable.

En este contexto, la implementación de mecanismos solidos de gobernanza del dato, auditoría, transparencia y explicabilidad, junto con soluciones técnicas orientadas a reducir riesgos, resulta esencial para garantizar la seguridad y confiabilidad de estas herramientas. No obstante, ninguna medida tecnológica puede sustituir el criterio jurídico del experto ni exonerar al profesional del Derecho de sus deberes de diligencia, verificación y control. La supervisión humana no es una opción, sino una obligación.