Twitter, Inteligencia Artificial y desinformación: el caso Maduro desde el Derecho penal tecnológico

Cuando los representantes políticos amplifican contenido falso o generado por IA, se diluyen las fronteras entre información oficial, propaganda y desinformación

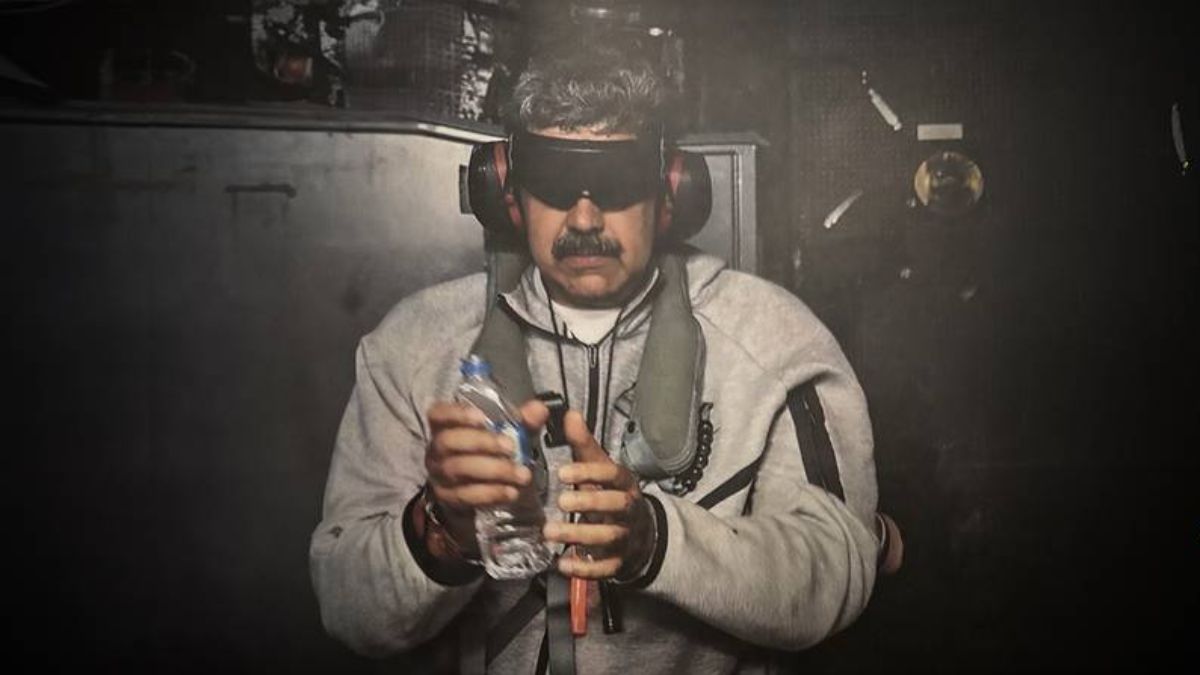

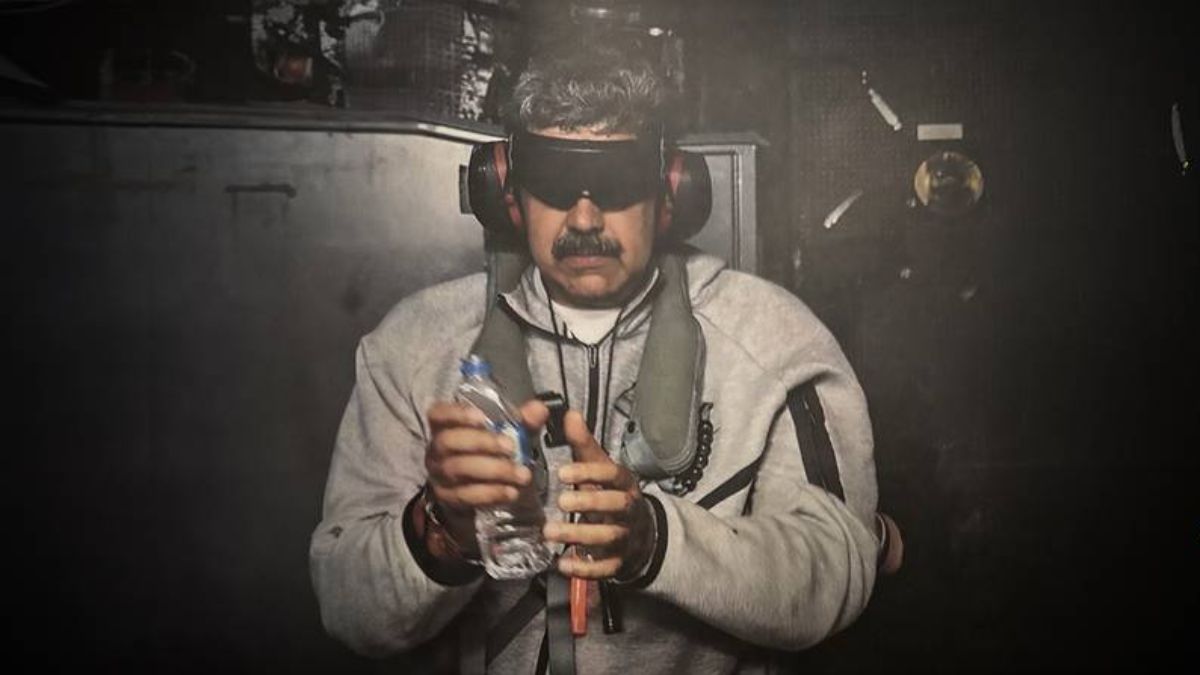

(Imagen: Gobierno de los Estados Unidos)

Twitter, Inteligencia Artificial y desinformación: el caso Maduro desde el Derecho penal tecnológico

Cuando los representantes políticos amplifican contenido falso o generado por IA, se diluyen las fronteras entre información oficial, propaganda y desinformación

(Imagen: Gobierno de los Estados Unidos)

En los conflictos políticos contemporáneos ya no basta con analizar los hechos desde la óptica del derecho internacional. Hoy, cualquier acontecimiento de relevancia global, ya sea real, hipotético o directamente falso, se libra de forma paralela en el espacio digital. El episodio de la detención de Nicolás Maduro constituye un ejemplo paradigmático de cómo Twitter (actualmente X) y las herramientas de Inteligencia Artificial han condicionado la percepción pública, la reacción política internacional y los desafíos jurídicos asociados a la cibercriminalidad y la desinformación.

Desde la perspectiva de un abogado especializado en delitos informáticos y Derecho penal tecnológico, lo relevante no es únicamente si la detención se produjo en los términos difundidos en redes sociales, sino cómo la narrativa de ese acontecimiento fue construida, amplificada y, en muchos casos, falsificada mediante plataformas digitales y tecnologías de generación automatizada de contenido.

Durante horas, e incluso días, Twitter/X se convirtió en el principal canal de difusión de informaciones, comunicados políticos, imágenes impactantes y vídeos virales que mostraban a Nicolás Maduro presuntamente arrestado, escoltado por fuerzas extranjeras o trasladado bajo custodia. Muchas de esas imágenes, posteriormente verificadas por medios y organizaciones verificación de hechos (o fact-checking), resultaron ser creaciones generadas por Inteligencia Artificial, montajes visuales o reutilización de material antiguo fuera de contexto. Sin embargo, para cuando fueron desmentidas, ya habían alcanzado millones de visualizaciones y habían moldeado la opinión pública internacional.

Este fenómeno no es accidental. La IA generativa ha democratizado la capacidad de producir contenido hiperrealista sin conocimientos técnicos avanzados, lo que multiplica el riesgo de manipulación informativa en escenarios políticamente sensibles. Desde el punto de vista jurídico, nos encontramos ante un problema estructural: la velocidad de difusión supera con creces la capacidad de reacción normativa, judicial y, en muchos casos, incluso periodística.

Suscríbete a nuestra

NEWSLETTER

(Imagen: RTVE)

La proliferación de bulos asociados a la captura de Maduro siguió patrones ya conocidos en otros conflictos: imágenes creadas por IA que simulaban fotografías de agencias internacionales, vídeos deepfake en los que se representaban celebraciones populares inexistentes, audios falsamente atribuidos a funcionarios gubernamentales y mensajes automatizados replicados por redes de bots. Todo ello fue amplificado por los algoritmos de Twitter/X, diseñados para priorizar contenido altamente emocional, polarizante y viral.

Desde una óptica penal, la dificultad radica en determinar la autoría, la intencionalidad y el daño causado. ¿Estamos ante simples usuarios desinformados que comparten contenido falso, o ante campañas coordinadas de desinformación con fines políticos? ¿Puede existir responsabilidad penal por la creación o difusión masiva de imágenes falsas generadas por IA que alteran el orden público o la percepción de un conflicto internacional? Estas preguntas, todavía abiertas en muchos ordenamientos jurídicos, adquieren especial relevancia cuando el contenido afecta a líderes políticos y a la estabilidad institucional de un país.

Paralelamente, Twitter/X no fue únicamente un canal de desinformación, sino también la plataforma elegida por gobiernos y representantes políticos para fijar posición oficial, reforzando su papel como espacio central de diplomacia digital. Por ejemplo, en España, el presidente del Gobierno, Pedro Sánchez, señalaba el mismo día 3 de enero a través de esta red social que España «no reconoce ni apoya intervenciones contrarias al derecho internacional«, posponiendo para el día 4 un comunicado realizado de forma conjunta con los Gobiernos de Brasil, Chile, Colombia, Uruguay y México expresando su preocupación frente a los hechos ocurridos en Venezuela.

En la misma línea, altos cargos de la administración estadounidense, así como figuras políticas de otros países, utilizaron la mencionada red social para emitir comunicados, expresar apoyo o rechazo a una eventual intervención y marcar relato ante la comunidad internacional. En particular, en el caso de Estados Unidos, varios representantes políticos recurrieron a Twitter/X para lanzar mensajes contundentes sobre la situación en Venezuela, apelando a la lucha contra el narcotráfico, la defensa de la democracia o la rendición de cuentas del chavismo. Algunos de estos comunicados fueron compartidos miles de veces y utilizados como «prueba» de la veracidad de las imágenes y vídeos que circulaban, a pesar de que no siempre existía correspondencia entre los mensajes oficiales y el material visual difundido.

Esta confusión deliberada o negligente entre comunicación institucional y contenido no verificado plantea un riesgo jurídico significativo. Cuando representantes políticos amplifican, directa o indirectamente, material falso o generado por IA, se difuminan las fronteras entre información oficial, propaganda y desinformación. Desde el derecho penal tecnológico, ello obliga a replantear el concepto de diligencia debida en la comunicación pública digital por parte de autoridades y cargos electos.

En 2018, Nicolas Maduro denunció en la ONU la agresión de Estados Unidos a Venezuela, al mismo tiempo que tendía la mano a la administración Trump para dialogar. (Imagen: RTVE)

Otros líderes internacionales también recurrieron a Twitter/X para posicionarse en el conflicto venezolano, ya fuera denunciando una injerencia extranjera, cuestionando la veracidad de las informaciones difundidas o alertando sobre el uso político de imágenes generadas por IA. Estas intervenciones evidencian que la red social ha dejado de ser un mero canal de opinión para convertirse en un escenario de confrontación política y jurídica, donde cada mensaje puede tener consecuencias diplomáticas y legales.

Uno de los aspectos más preocupantes del episodio analizado es la normalización del uso de contenidos generados por IA en contextos de alta tensión política. Desde una perspectiva penal, los deepfakes y montajes hiperrealistas no son simples falsificaciones: pueden constituir instrumentos de manipulación psicológica colectiva, capaces de provocar disturbios, reacciones violentas o decisiones políticas basadas en información falsa. El daño no es solo reputacional, sino potencialmente estructural para el orden democrático.

A ello se suma la responsabilidad de las plataformas. Twitter/X ha sido objeto de críticas por la lentitud en etiquetar o limitar la difusión de contenidos falsos relacionados con el caso Maduro. La corrección realizada después del episodio aquí analizado resulta insuficiente cuando el impacto del bulo ya se ha producido. Desde el punto de vista del derecho penal tecnológico y de la regulación digital, este escenario refuerza la necesidad de mecanismos preventivos, trazabilidad del contenido generado por IA y obligaciones claras de transparencia algorítmica.

Así las cosas, el caso de la detención de Nicolás Maduro constituye una advertencia jurídica de primer orden. Demuestra cómo Twitter/X y la Inteligencia Artificial pueden alterar la percepción global de un acontecimiento político en cuestión de minutos, generando un ecosistema donde la verdad compite en clara desventaja frente a la viralidad. Para el derecho penal tecnológico, el reto ya no es solo castigar conductas ilícitas, sino proteger el espacio informativo como bien jurídico colectivo, garantizando que la tecnología no se convierta en un arma de desestabilización masiva.