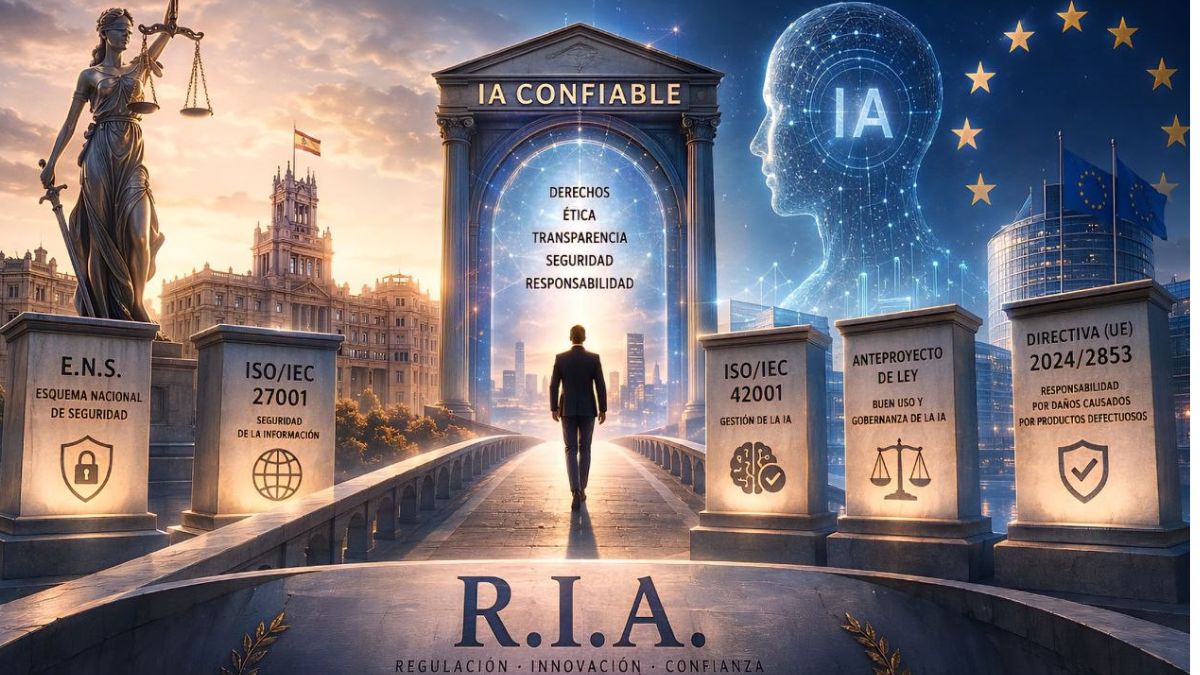

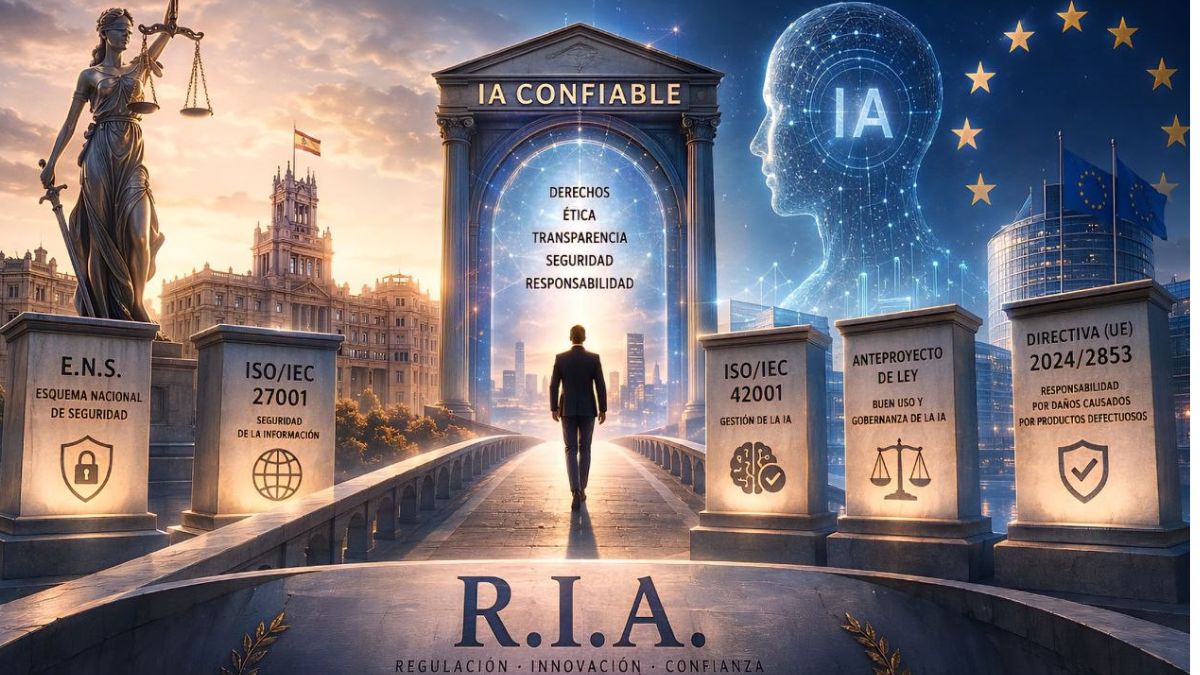

El marco jurídico complementario al R.I.A. que vela por una «IA confiable» en España

Una aproximación al E.N.S., las ISO/IEC 27001 y 42001, el Anteproyecto de Ley para el buen uso y gobernanza de la IA y la Directiva (UE) 2024/2853

(Imagen: Pablo Sáez)

El marco jurídico complementario al R.I.A. que vela por una «IA confiable» en España

Una aproximación al E.N.S., las ISO/IEC 27001 y 42001, el Anteproyecto de Ley para el buen uso y gobernanza de la IA y la Directiva (UE) 2024/2853

(Imagen: Pablo Sáez)

El Reglamento (UE) 2024/1689 ha fijado el marco europeo de la inteligencia artificial, pero el cumplimiento real en España depende de un entramado complementario que convierte la gobernanza en práctica demostrable. El Esquema Nacional de Seguridad aporta ciberseguridad exigible; ISO/IEC 27001 y 42001 introducen una lógica de gestión verificable; el anteproyecto español ordena competencias, coordinación y reacción sancionadora; y la Directiva (UE) 2024/2853 amplía la exposición patrimonial ligada a software, actualizaciones y servicios conexos. Ese es el ecosistema que hoy sostiene, aterriza y completa la promesa del RIA.

| CLAVES DE LECTURA |

| • El AI Act no agota por sí solo la gobernanza operativa de la IA en España.

• El ENS introduce seguridad, riesgo, resiliencia y trazabilidad en entornos públicos y en sus contratistas. • ISO/IEC 27001 e ISO/IEC 42001 convierten la diligencia en un sistema gestionado, documentable y auditable.

Suscríbete a nuestra • El anteproyecto español articula coordinación institucional, espacios controlados de pruebas y proporcionalidad sancionadora. • La Directiva (UE) 2024/2853 desplaza la responsabilidad también hacia software, actualizaciones y servicios conexos. |

El AI Act cuenta con otros apoyos nacionales

El AI Act ordena el mercado interior, despliega un enfoque basado en riesgos y exige a los Estados miembros articular autoridades competentes, vigilancia del mercado y sanciones eficaces. Pero el Reglamento no agota por sí solo la realidad del cumplimiento. Ningún operador serio puede gobernar un sistema de IA de alto riesgo leyendo únicamente el texto europeo. Hace falta una capa que asegure seguridad técnica, trazabilidad organizativa y respuesta patrimonial cuando el daño ya se ha manifestado. En España, esa capa la forman el ENS, las ISO 27001 y 42001, y el binomio compuesto por el anteproyecto español de gobernanza de la IA y la Directiva de productos defectuosos. Sin ese trípode, el AI Act corre el riesgo de quedarse en una arquitectura correcta pero insuficientemente aterrizada.

(Imagen: Pablo Sáez)

El ENS como escudo cibernético obligatorio

El primer pilar es el menos discutido en el debate generalista y, sin embargo, el más determinante para administraciones públicas y contratistas: el Esquema Nacional de Seguridad. El Real Decreto 311/2022 se aplica a todo el sector público y también a las entidades privadas que, en virtud de relación contractual, prestan servicios o proveen soluciones a la Administración. Su objeto declarado es asegurar acceso, confidencialidad, integridad, trazabilidad, autenticidad, disponibilidad y conservación de datos, información y servicios. No es un complemento decorativo del ecosistema digital; es la disciplina mínima de ciberseguridad que cualquier despliegue público de IA debe respetar desde el diseño hasta la operación.

Lo decisivo es que el ENS completa al AI Act allí donde este último no entra en el detalle cotidiano de la seguridad operacional. Los artículos 6 y 7 del ENS sitúan la seguridad como proceso integral y la gestión basada en los riesgos en el centro del sistema, mientras que el anexo I obliga a categorizar los sistemas como básicos, medios o altos y el anexo II despliega medidas organizativas, operacionales y de protección proporcionales a esa categorización. Además, el ecosistema del CCN desarrolla esa arquitectura con instrucciones técnicas, guías STIC Serie 800 y herramientas de gobernanza como INES, AMPARO y MARGA, lo que convierte el cumplimiento en una práctica verificable. Traducido al lenguaje empresarial: Si una IA se usa en contratación pública, sanidad, justicia o servicios digitales administrativos, no basta con hablar de ética o transparencia; hay que hablar de seguridad, cadena de suministro, auditoría y resiliencia.

ISO 27001 e ISO 42001 como excelencia alineada

El segundo pilar es el de los estándares. Aquí conviene evitar dos errores simétricos: creer que las ISO sustituyen al Derecho o despreciarlas porque no son ley. Ni una cosa ni la otra. ISO/IEC 27001:2022 establece los requisitos de un sistema de gestión de la seguridad de la información y promueve un enfoque integral que combina personas, políticas y tecnología. ISO/IEC 42001:2023, primera norma internacional de sistema de gestión específica para inteligencia artificial, ofrece una estructura para gestionar riesgos y oportunidades, reforzar trazabilidad y transparencia y demostrar un uso responsable de la IA. Ambas están dirigidas a organizaciones de cualquier tamaño y ambas descansan en la lógica de mejora continua propia de los sistemas de gestión.

Lo que de verdad cambia es que estas normas convierten la diligencia en prueba. Sus cláusulas siguen la gramática ya conocida de contexto, liderazgo, planificación, soporte, operación, evaluación del desempeño y mejora, y precisamente por eso encajan con notable naturalidad en el cumplimiento del AI Act. No equivalen a una presunción automática de conformidad, pero sí proporcionan un lenguaje operativo para documentar decisiones, asignar responsabilidades, ordenar controles y demostrar madurez organizativa ante clientes, reguladores, auditores y tribunales. Para proveedores de alto riesgo, para entidades financieras, para despachos y para integradores tecnológicos, ISO 27001 e ISO 42001 son hoy una de las vías más sólidas para pasar de la retórica de la IA responsable a una gobernanza defendible y auditable.

(Imagen: Pablo Sáez)

La ley española que aterriza competencias y sanciones

El tercer pilar empieza con el Anteproyecto de Ley para el buen uso y la gobernanza de la inteligencia artificial. Su relevancia no está solo en acompañar al AI Act, sino en hacer algo que el ecosistema necesitaba con urgencia: aterrizar competencias, coordinación y reacción sancionadora en clave española. El Consejo de Ministros lo aprobó el 11 de marzo de 2025 y el texto atribuye a la Agencia Española de Supervisión de la Inteligencia Artificial un papel central de coordinación: puede poner en marcha medidas para articular actuaciones preventivas y de supervisión, preside, gestiona y lleva la secretaría de la Comisión mixta de coordinación de autoridades de vigilancia del mercado, y asume responsabilidades relevantes en la gobernanza de los espacios controlados de pruebas. Al mismo tiempo, el anteproyecto ordena el reparto sectorial de supervisión y busca evitar respuestas fragmentadas o contradictorias.

Además, el anteproyecto acierta en un punto especialmente sensible para empresas y asesores: introduce flexibilidad proporcionada para pymes y sector público sin vaciar la seriedad del sistema. Para determinadas infracciones leves de pymes se contempla el apercibimiento y la corrección de la conducta, excluyendo la imposición de multas administrativas; y para entidades del sector público puede prevalecer una lógica correctora sobre la multa pecuniaria. No es indulgencia; es diseño regulatorio inteligente. Permite exigir cumplimiento sin destruir capacidad de adaptación y sitúa a España como laboratorio vivo de gobernanza IA, no solo por su ambición normativa, sino por la combinación entre supervisión, pedagogía y proporcionalidad.

La responsabilidad civil ya no termina en el ‘hardware’

(Imagen: Pablo Sáez)

La otra mitad del tercer pilar es la Directiva (UE) 2024/2853 sobre responsabilidad por productos defectuosos. Aquí conviene ser diáfanos: el viejo imaginario de la responsabilidad centrada en el objeto físico ha quedado superado. La nueva Directiva incluye los programas informáticos en el ámbito del producto, contempla componentes y servicios conexos bajo control del fabricante y da relevancia jurídica a las actualizaciones, mejoras y modificaciones sustanciales del software. En otras palabras, la responsabilidad ya no mira solo al hardware; mira también a la capa digital que mantiene, altera o condiciona el funcionamiento del producto.

Para la gobernanza de la IA, esto es capital. Significa que el mapa de exposición jurídica ya no se agota en el diseño inicial ni en el momento de puesta en el mercado. El defecto puede nacer, agravarse o revelarse después, a través de una actualización, de un servicio digital interconectado o de una evolución funcional mantenida bajo control del fabricante. En litigación, esto estrecha la distancia entre compliance, ciberseguridad y responsabilidad civil. En consejo preventivo, obliga a revisar contratos, registro de cambios, gobernanza del dato, gestión de proveedores y vigilancia poscomercialización. La frontera entre calidad jurídica y calidad técnica se vuelve, sencillamente, mucho más estrecha.

El Q2 2026 que redefine la práctica

Si se observa el conjunto, la conclusión es nítida. El AI Act establece la columna vertebral. El ENS protege la infraestructura institucional y contractual. ISO 27001 e ISO 42001 convierten la gobernanza en sistema gestionado y revisable. El anteproyecto español asigna autoridades y coordina la vigilancia. Y la Directiva 2024/2853 cierra el ecosistema por la vía de la responsabilidad civil. Ese es el gran giro. Y ese es el Q2 2026 que redefine la práctica para empresas, administraciones públicas y profesionales del Derecho: ya no basta con preguntarse si un sistema de IA entra o no en el AI Act; hay que preguntarse si es seguro, gobernable, demostrable y reparable.

Ahí reside la condición de España como laboratorio vivo de gobernanza de IA. La publicación de las 16 guías prácticas derivadas del sandbox y la musculatura operativa del CCN-CNI muestran que el país no se está limitando a esperar estándares futuros; está construyendo ya rutas de implementación. Para despachos, tecnológicas, integradores y compliance officers, la señal es inequívoca: la gobernanza excelente será la que consiga alinear norma, gestión y evidencia. Porque la IA confiable no se proclama. Se diseña, se protege, se documenta y se prueba antes de que llegue el incidente.

| NORMATIVA REVISADA |

| • Reglamento (UE) 2024/1689 (AI Act).

• Real Decreto 311/2022, de 3 de mayo, por el que se regula el Esquema Nacional de Seguridad. • ISO/IEC 27001:2022 e ISO/IEC 42001:2023. • Anteproyecto de Ley para el buen uso y la gobernanza de la inteligencia artificial. • Directiva (UE) 2024/2853 sobre responsabilidad por productos defectuosos. |

(Imagen: Pablo Sáez)